在當(dāng)今的大模型后訓(xùn)練(Post-training)階段,DPO(直接偏好優(yōu)化) 憑借其無(wú)需訓(xùn)練獨(dú)立 Reward Model 的優(yōu)雅設(shè)計(jì)和高效性,成功取代 PPO 成為業(yè)界的 「版本之子」,被廣泛應(yīng)用于 Llama-3、Mistral 等頂流開(kāi)源模型的對(duì)齊中。

然而,隨著對(duì)模型能力要求的日益嚴(yán)苛,DPO 的缺陷逐漸浮出水面。

究竟該如何讓 DPO 學(xué)會(huì)「去偽存真」,精準(zhǔn)識(shí)別出那些真正決定勝負(fù)的 Critical Tokens?

針對(duì)這一問(wèn)題,來(lái)自中國(guó)科學(xué)院自動(dòng)化研究所、字節(jié)跳動(dòng)、微軟亞洲研究院和北京科技大學(xué)的研究者們?cè)诒贿x為 ICLR 2026 Oral 的新工作中聯(lián)合提出了一種全新的 TI-DPO 框架。

- 論文:《Token-Importance Guided Direct Preference Optimization》

- 論文地址:https://arxiv.org/abs/2505.19653

- 開(kāi)源地址:https://github.com/gracefulning/TIDPO

研究背景與意義

主流方法正面臨兩個(gè)核心難題,這使得模型難以實(shí)現(xiàn)真正精細(xì)化的語(yǔ)義控制:

- 痛點(diǎn)一:序列級(jí)的「二元對(duì)立」陷阱。傳統(tǒng)方法依然停留在序列級(jí)別(Sequence-level)的粗粒度優(yōu)化上,簡(jiǎn)單粗暴地將數(shù)據(jù)劃分為好與壞。這種二元監(jiān)督信號(hào)極度匱乏,因?yàn)樗谏w高質(zhì)量回復(fù)中可能混雜著瑕疵 Token 的事實(shí),導(dǎo)致了模型在連續(xù)語(yǔ)義空間中微調(diào)效果差,甚至引發(fā)采樣分布偏移(Distribution Shift)。

- 痛點(diǎn)二:被偏差綁架的「?jìng)巍怪匾?/strong>。即使試圖下沉到 Token 級(jí)別,現(xiàn)有的重要性評(píng)估手段也存在問(wèn)題。許多方法依賴概率預(yù)測(cè)或簡(jiǎn)單加權(quán),這導(dǎo)致它們直接繼承了模型架構(gòu)的固有缺陷 ——「U 型注意力偏差」(Lost in the Middle),模型天生傾向于過(guò)度關(guān)注首尾 Token 而忽略中間的核心語(yǔ)義。

TI-DPO 的核心機(jī)制

TI-DPO 的核心思想是:既然 Token 生而不同,那就給它們「加權(quán)」。 通過(guò)引入混合加權(quán)機(jī)制和三元組損失,TI-DPO 能夠精準(zhǔn)識(shí)別并放大「關(guān)鍵 Token」的信號(hào),同時(shí)抑制噪聲,從而實(shí)現(xiàn)比傳統(tǒng) DPO 更準(zhǔn)、更穩(wěn)的對(duì)齊效果。它主要包含兩大核心機(jī)制:

1. 混合加權(quán)機(jī)制 (Hybrid Weighting)

為了找出誰(shuí)才是決定回復(fù)質(zhì)量的「勝負(fù)手」,TI-DPO 設(shè)計(jì)了一套數(shù)據(jù)驅(qū)動(dòng)與先驗(yàn)結(jié)構(gòu)相結(jié)合的權(quán)重計(jì)算法:

- 梯度歸因:計(jì)算 Loss 對(duì)每個(gè) Token Embedding 的梯度范數(shù)。簡(jiǎn)單來(lái)說(shuō),誰(shuí)對(duì)最終輸出貢獻(xiàn)大,誰(shuí)的權(quán)重就高。

- 高斯先驗(yàn):針對(duì) LLM 常見(jiàn)的「U 型注意力偏差」(過(guò)度關(guān)注開(kāi)頭結(jié)尾),引入高斯分布強(qiáng)制模型關(guān)注中間的語(yǔ)義核心。

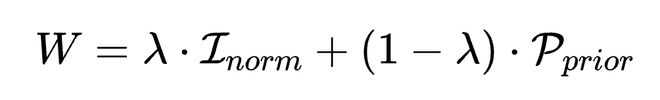

最終的 Token 權(quán)重 ,是這兩者的凸組合: