DeepSeek這小子最精了,當(dāng)全世界都在盯著他的GitHub倉(cāng)庫(kù),等待V4時(shí)——

他和北大、清華在ArXiv悄咪咪地上了一篇論文,發(fā)布了一個(gè)全新的針對(duì)智能體的推理框架:DualPath

而且就跟前幾天曝出的算力話題相關(guān)。

DualPath的核心在于解決Agent長(zhǎng)文本推理場(chǎng)景下的I/O瓶頸,通過(guò)優(yōu)化從外部存儲(chǔ)加載KV-Cache的速度,確保計(jì)算資源不被存儲(chǔ)讀取拖累。

它改變了傳統(tǒng)的存儲(chǔ)至預(yù)填充引擎(Storage-to-Prefill)單路徑加載模式,引入了存儲(chǔ)至解碼引擎(Storage-to-Decode)的第二條路徑。

通過(guò)利用解碼引擎閑置的存儲(chǔ)網(wǎng)卡(SNIC)帶寬讀取緩存,并配合高速計(jì)算網(wǎng)絡(luò)(RDMA)將其傳輸至預(yù)填充引擎,DualPath實(shí)現(xiàn)了集群存儲(chǔ)帶寬的全局池化與動(dòng)態(tài)負(fù)載均衡。

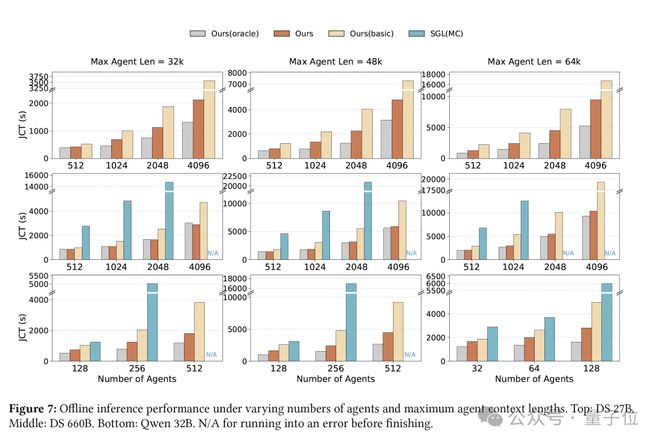

在660B規(guī)模的生產(chǎn)級(jí)模型的實(shí)測(cè)中,DualPath表現(xiàn)驚人:

離線推理吞吐量提高了1.87倍,在線服務(wù)吞吐量平均提升1.96倍

在高負(fù)載下,首字延遲(TTFT)大幅優(yōu)化,而 Token間的生成速度(TPOT)幾乎不受任何干擾。

接下來(lái),我們一起來(lái)看。

雙路徑加載 (Dual-Path Loading)

總的來(lái)說(shuō),DualPath是一個(gè)專門為智能體系統(tǒng)設(shè)計(jì)的推理框架,它的核心洞見(jiàn)是——

KV-Cache的加載不必以預(yù)填充為中心

在以往的理解中,誰(shuí)負(fù)責(zé)計(jì)算誰(shuí)就去搬數(shù)據(jù)。但DualPath認(rèn)為,緩存可以先加載到解碼引擎中,再通過(guò)高性能RDMA網(wǎng)絡(luò)傳輸至預(yù)填充引擎。

通過(guò)在兩條路徑間動(dòng)態(tài)選擇,DualPath重新分配了 網(wǎng)絡(luò)負(fù)載,緩解了預(yù)填充側(cè)的帶寬壓力。

那么,為什么要費(fèi)這么大勁去“繞路”?

之所以這樣做,是因?yàn)樵诋?dāng)前的智能體應(yīng)用中,對(duì)話輪數(shù)多且上下文長(zhǎng),KV-Cache命中率通常高達(dá)95%以上。